霍金获得过诺贝尔奖吗 霍金为何不看好人工智能前景原因

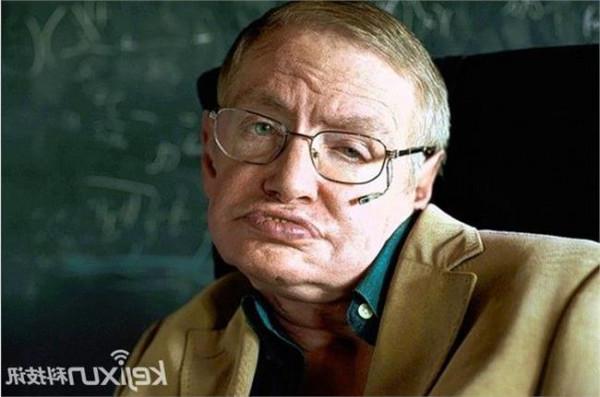

霍金对于人工智能的恐惧也许比黑洞大得多。早在去年12月,这名渐冻人英国著名物理学家斯蒂芬就对人工智能的发展前景发出了悲观预测,那时候他认为人工智能的高速发展可能最终导致人类终结。即使在看电影的时候,霍金也不忘呼吁人类要关注人工智能的安全问题。

去年5月,在看完约翰德普的影片《超验骇客》,他就在《独立》杂志中撰文表达了这一问题。他担忧的对象不仅仅是未来的人工智能技术,甚至还包括现在的一些公司比如谷歌和Facebook。他说:人工智能的短期影响取决于由谁来控制它,而长期影响则取决于它是否能够被控制。

如果说之前的担忧还只是预演的话,那这一次,霍金联合企业家对人工智能领域的发出的公开信就等于是正式警告。据英国《金融时报》12日报道,近日,包括霍金及企业家埃伦马斯克(Elon Musk)等在内的数位科学家、企业家及与人工智能领域有关的投资者联名发出了一封公开信,警告人们必须更多地注意人工智能(AI)的安全性及其社会效益。

这封发自生命未来研究所(Future of Life Institute,简称FLI)的公开信还附带了一篇论文,其中建议应优先研究强大而有益的人工智能。

目前,人们日益担心机器的智力和能力可能会超过创造它们的人类,从而影响到人类的就业,甚至影响到人类的长期生存。这封公开信表示:由于人工智能的巨大潜力,开展如何在规避其潜在陷阱的同时获取其好处的研究十分重要。我们的人工智能系统,必须按照我们的意愿工作。

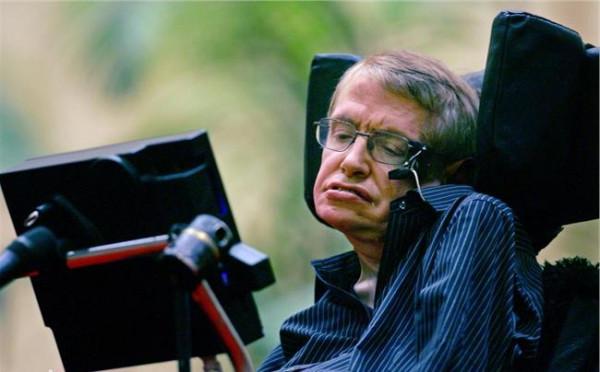

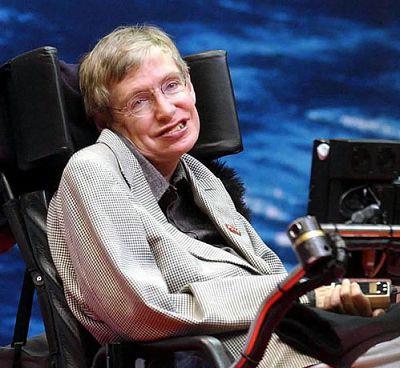

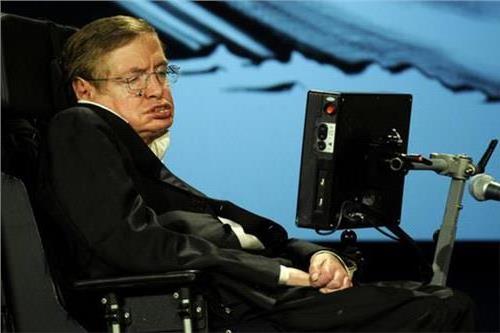

其实,霍金本人也是人工智能的获益者。这名渐冻人英国著名物理学家多年依靠一套量身定制的电脑软件与他人交流,而这套软件证实一款应用了人工智能技术的说话工具。